在短视频(TikTok, 抖音, YouTube Shorts, 视频号)占据绝对流量霸权的今天,内容创作者面临的最大瓶颈就是“出片产能”。哪怕你才华横溢,剪辑一条 3 分钟的口播加混剪视频,也往往需要耗费 4 到 6 个小时:写脚本、找素材、配音、卡点、对轴、上字幕,步骤繁琐且极其枯燥。

我们在上一篇《OpenClaw 自动发小红书图文矩阵》中解决了图文创作的痛点。但图文和视频是完全不同的维度——视频包含了庞大的多媒体文件流和复杂的工程轨道(Timeline)。

很多人梦想着能有一键生成完美视频的 AI,但在 2026 年的实际商用环境中,纯 AI 生成的视频往往面临着“画面逻辑跳跃”、“没有爆款网感”等致命问题。因此,目前短视频矩阵最成熟、转化率最高的玩法是:“半自动化出片(Semi-Automated Production)”。即让 AI 承担 80% 的前期繁重工作(文案、素材、配音、草稿轨道生成),让人类剪辑师保留 20% 的艺术把控(转场、爆点微调、封面设计)。

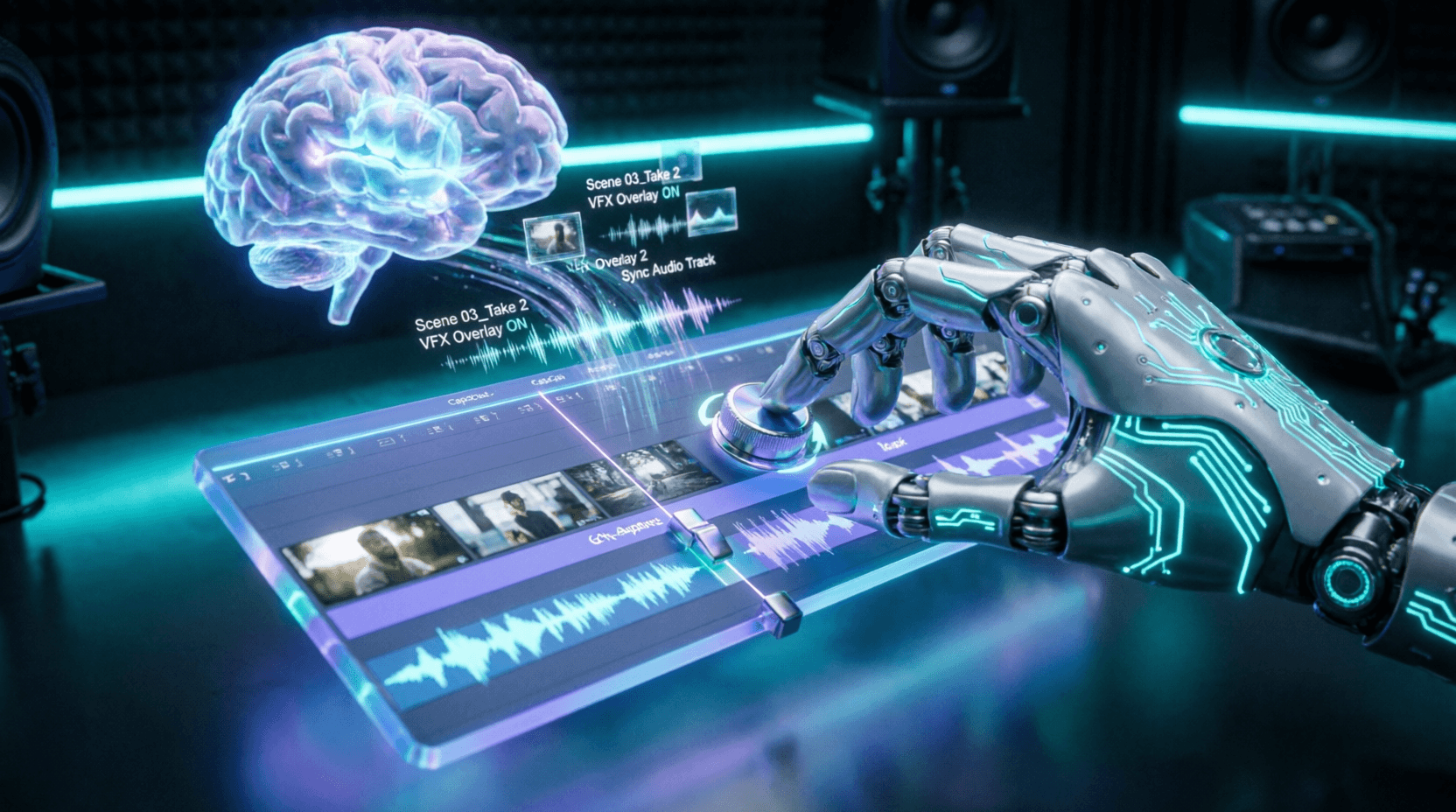

本文将硬核揭秘:如何让 OpenClaw 与目前最强大的国民级剪辑软件 剪映(CapCut 专业版) 深度联动,打造一条极其强悍的半自动化短视频出片流水线!

一、 为什么是“OpenClaw + 剪映”?

市面上有很多“一键图文转视频”的工具(如度剪、各类云端 SaaS),但专业创作者很少使用它们,原因很简单:这些工具不支持导出剪辑工程文件,无法进行二次精细化修改。

而剪映电脑版(CapCut Desktop)的工程文件本质上是一个基于 JSON 的本地数据结构(draft_content.json)。这意味着什么?这意味着具备强大系统级底层操作能力的 OpenClaw,可以不经过鼠标点击,直接通过代码和文件读写,在后台替你“捏”出一个完整的剪映草稿工程!

二、 流水线前置准备:你需要的插件与环境

要让 OpenClaw 接管繁重的多媒体任务,你需要配置好以下“数字工具箱”。如果你还没有安装 OpenClaw,请先参考我们的 Windows 极速版安装教程 或 Mac 芯片原生安装指南。

- Python 环境与 FFmpeg: 视频处理的底层基石。请确保你的电脑已经安装了 FFmpeg 并配置了环境变量,这是拼接和转码视频必须用到的神器。

- OpenClaw Skill 插件配置:

FileSystem Pro(用于读写本地文件、创建剪映草稿目录)Web Scraper / Puppeteer(用于自动抓取无版权视频网站,如 Pexels)TTS Engine(文本转语音插件,可选接 Edge-TTS 或 ElevenLabs)Advanced Terminal(用于执行 Python 音视频对齐脚本)

- 安装剪映专业版 (CapCut Desktop): 请确保安装在默认路径,方便 AI 定位草稿文件夹(Windows 通常在

AppData/Local/JianyingPro/User Data/Projects)。

三、 核心流水线拆解:SOP 主控指令 (Master Prompt)

这是整套系统的心脏。你不需要自己去写复杂的 JSON 文件,只需要将以下指令(Prompt)发送给 OpenClaw,它会像一个老练的编导和剪辑助理一样,为你准备好一切。

🎬 短视频半自动出片 SOP 指令(直接复制使用):

【任务指令】:启动短视频全链路半自动化剪辑流水线。

【任务主题】:今天我们要制作一条关于“2026年苹果WWDC发布会总结”的 1 分钟解说类短视频。

请严格遵循以下 4 个阶段执行任务,每完成一个阶段请向我汇报:

阶段 1:文案与分镜脚本创作 (Scripting)

- 搜索最新的苹果 WWDC 发布会资讯。

- 撰写一段约 250 字的短视频口播文案,要求:开头前 3 秒必须抛出痛点悬念,语速快,网感强。

- 将文案按句子拆分为一个带有时间轴估算的分镜表格(包含:分镜序号、画面描述、口播台词)。

阶段 2:语音合成与素材准备 (Assets Generation)

- 调用 TTS 插件,将“口播台词”转为语音音频文件 `voiceover.mp3`,保存在 `D:\AutoVideo\Project_1\`。

- 根据“画面描述”,调用网页爬虫或本地素材库,寻找匹配的 5-8 段背景视频素材(优先下载 .mp4 格式),存入同文件夹下的 `\materials\` 目录中。

阶段 3:草稿工程生成 (Draft Building)

- 调用 Terminal 执行我本地的 Python 辅助脚本 `D:\AutoVideo\generate_capcut_draft.py`。

- 脚本会将刚才生成的 `voiceover.mp3` 铺在主音频轨道,并将下载的视频素材随机或按顺序平铺在主视频轨道上。

- 生成的工程命名为 "WWDC_AutoDraft",并存入剪映的默认草稿文件夹。

阶段 4:交付确认

- 任务完成,通知我打开剪映专业版,找到 "WWDC_AutoDraft" 进行最终的人工精剪。

四、 核心黑科技:如何让 AI 自动生成“剪映草稿”?

上面的流水线中提到了一个 generate_capcut_draft.py 脚本。这是整套半自动化出片的灵魂。剪映的 draft_content.json 虽然加密了一部分,但开源社区(GitHub 上有很多相关的项目)已经逆向解析出了它的基本结构:包括轨道(Tracks)、素材(Materials)、和片段(Segments)。

为了让 OpenClaw 顺利执行,你需要在电脑里准备这样一个 Python 脚本,告诉它如何把你杂乱的音频和视频拼凑成一个能被剪映识别的工程:

# 这是一个概念性演示脚本 (generate_capcut_draft.py)

import os

import json

import uuid

def create_capcut_draft(project_name, video_dir, audio_path):

# 1. 找到剪映的草稿存放目录 (以 Windows 为例)

draft_root = os.path.expanduser(r'~\AppData\Local\JianyingPro\User Data\Projects\com.lveditor.draft')

project_path = os.path.join(draft_root, project_name)

os.makedirs(project_path, exist_ok=True)

# 2. 构建基础 JSON 结构

draft_json = {

"id": str(uuid.uuid4()),

"materials": {"videos": [], "audios": []},

"tracks": [{"id": str(uuid.uuid4()), "type": "video", "segments": []},

{"id": str(uuid.uuid4()), "type": "audio", "segments": []}]

}

# 3. 让 Python 自动将你的素材路径写入上述 JSON

# (具体计算时长和对轴的代码较长,可借助 FFmpeg 获取时长后填入)

# ... 省略底层 JSON 拼接细节 ...

# 4. 写入文件

with open(os.path.join(project_path, 'draft_content.json'), 'w', encoding='utf-8') as f:

json.dump(draft_json, f)

# 创建 metadata 标记文件

with open(os.path.join(project_path, 'draft_meta_info.json'), 'w') as f:

f.write('{"draft_name": "'+ project_name +'"}')

print(f"剪映草稿 {project_name} 生成成功!")

# 接受 OpenClaw 传入的参数并执行

import sys

create_capcut_draft(sys.argv[1], sys.argv[2], sys.argv[3])

当你将这段脚本赋予 OpenClaw 后,它在搜集完素材,会立刻运行这个代码。下一秒,你打开桌面的剪映,就会发现一个全新的草稿静静地躺在那里。点开后,配音已经在下方的轨道上,素材视频已经铺在了上方轨道,你只需要点一下剪映自带的“识别字幕”并加上几套网红特效,一条视频就做完了!

五、 终极玩法:全自动“混剪”矩阵与二次原创

对于做“好物推荐”、“影视解说”或“名场面盘点”的矩阵号来说,原创度是生死线。如果你下载了网上的视频直接发,分分钟被判定为“搬运”而限流。

利用 OpenClaw,你可以引入高级去重与二次原创指令:

- 指令植入: “在调用 FFmpeg 或组装草稿前,请针对所有下载的视频素材执行:1. 水平镜像翻转; 2. 放大 105% 裁剪边缘; 3. 随机抽取 2-3 秒切片打乱顺序。”

- 文案洗稿: 参考我们《全自动生成长文防检测》的逻辑,让 AI 在写口播脚本时,用自己的语言重述,彻底规避文案查重。

六、 常见报错与排障指南 (Troubleshooting)

视频处理是典型的“重体力活”,你的 AI 和你的电脑在这个过程中可能会面临崩溃的考验:

报错 1:打开生成的草稿,剪映提示“素材丢失 (Media Offline)”

原因: 剪映的 JSON 对文件路径极其敏感。如果 OpenClaw 在写入 JSON 时使用了相对路径,或者路径中含有中文字符/空格,剪映将无法索引到该文件。

解决: 强制要求 OpenClaw 在调用 Python 时使用绝对路径(Absolute Path),并且在建立工程文件夹时,统一使用纯英文和下划线命名(例如:Project_WWDC_2026)。

报错 2:Agent 在处理视频素材时报错 "Error 500: Execution timeout" 或闪退

原因: 视频文件体积过大,或者调用浏览器抓取视频时占用了太多内存,导致 Node/Python 后端进程 OOM(内存溢出)超时。

解决: 这是老生常谈的问题。请参阅我们详细的 《OpenClaw Error 500 排障指南》,务必将插件的超时限制放宽到至少 10 分钟(600000ms),并在配置本地 Ollama 模型 时留足虚拟内存空间。

报错 3:TTS 语音与视频素材时长严重不匹配

原因: AI 只知道平铺素材,无法精确判断每句话读出来的秒数。

解决: 这就是为什么我们叫它“半自动化”。AI 只能帮你把素材拉进时间线,精准的“卡点对轴”依然需要人类在剪映 UI 界面中微调。不要强求 AI 一次成片,节省 80% 的前期组装时间已经是巨大的效率提升。

七、 常见问题解答 (FAQ)

Q1: 这套流水线每天能产出多少条短视频?

如果你拥有足够的硬件算力(比如一台 M芯片 Mac 或 4090 PC),并跑通了整个流,一台机器每天产出 30-50 条带有粗剪对轴的短视频工程是没有问题的。人类剪辑师只需要像流水线工人一样,每天花 2 小时打开这些草稿,套模板、上字幕、批量导出即可。

Q2: OpenClaw 可以直接导出 MP4 吗,跳过剪映?

可以的。如果你不需要人工进行任何修改,你可以直接让 OpenClaw 使用 FFmpeg 命令行在后台将音频、视频和字幕强行合成并渲染输出为 MP4。但这种纯机器合成的视频通常网感较差,缺乏转场和贴纸特效,容易被判定为低质量营销号。

Q3: 这种半自动化视频能开通平台收益(如中视频计划/YouTube 获利)吗?

关键在于你最后那 20% 的人工精调。如果你对 AI 抓取的素材进行了大量的人工重组、添加了具有个人特色的贴纸、字幕解说和 BGM,它完全符合平台的“二次创作”标准,获取收益没有问题。千万不要把 AI 直接拼贴的“无聊 PPT 视频”不加修改地原样发布。

结语:让剪辑师转型为“视频导演”

将 OpenClaw 与剪映结合,并不是要抢走剪辑师的饭碗,而是要彻底改变短视频创作的生产关系。当你不再需要去网站上一页页翻找素材、不再需要一句句把语音拖入时间轴,你就不再是一个“操作工”。

你将成为一个运筹帷幄的“视频导演”。你的 OpenClaw 是你的副导演和素材统筹,你只需要审核它交上来的草稿,打磨最后的质感,然后迎接流量的爆发!

👉 下一步的高阶财富密码:

掌握了流量密码后,如何利用 AI 在金融市场中捕捉机会?敬请关注我们的下一篇神级应用:《OpenClaw 炒股插件:量化交易与每日研报自动生成》,教你打造一个没有感情的赚钱机器!