在这个数据爆发的时代,我们每个人的电脑硬盘里都沉睡着一座金矿:数以百计的行业研报 PDF、堆积如山的客户数据 Excel、以及常年不整理的 TXT/Markdown 个人笔记。过去,要从中提取有用的信息,无异于大海捞针。

自从 ChatGPT 和 Claude 支持文件上传后,很多人习惯把文件拖进网页框里让 AI 分析。但这种做法存在两个致命缺陷:一是数据隐私泄露风险,很多公司严禁将带有保密协议的合同或财务报表上传到外部服务器;二是无法批量处理,网页端通常限制一次只能上传 5-10 个文件,如果面临几千份简历或几万条物流数据,网页端 AI 瞬间就会崩溃。

这时候,作为运行在你本地电脑上的智能管家,OpenClaw 的优势就彻底爆发了。通过赋予 OpenClaw 直接读取本地文件系统(Local File System)的权限,配合内置的 Python 处理环境,它能以每分钟解析上百个文件的恐怖速度,帮你彻底榨干本地数据的商业价值。

本文将手把手教你如何打造一套 OpenClaw 本地文件批量解析与处理流水线,涵盖 TXT 文本归纳、PDF 智能信息提取,以及 Excel 数据的 Python 自动化分析。

一、 为什么 OpenClaw 处理本地文件更强?

在讨论具体操作前,我们先来看看为什么重度办公用户必须学会使用 OpenClaw 替代网页端对话框:

二、 前置准备:激活文件处理三大神级插件

OpenClaw 本身是一个指挥中枢,要让它具备“看懂”各种文件的能力,你需要前往 Skill Market(插件市场,参阅 《OpenClaw 十大神级插件推荐》)安装以下三个必备核心插件:

- FileSystem Pro: 赋予 OpenClaw 读取(Read)、写入(Write)、遍历(List Directory)本地硬盘文件夹的最高权限。

- Document Parser (PDF/Docx OCR): 专门用于对付带有复杂排版、表格甚至扫描件的 PDF 和 Word 文档,内置了强大的 OCR(光学字符识别)模块。

- Python Advanced Executor: 处理超大型 Excel/CSV 的唯一解,让 AI 变身为会写代码的本地数据分析师。

⚠️ 安全警告 (Security Alert):

开启 FileSystem 权限意味着 AI 可以读取你电脑上的任何文件。强烈建议在 OpenClaw 设置中,将 Workspace Directory(工作区目录)限制在一个特定的文件夹(例如 D:\AI_Workspace\),防止 AI 因为幻觉误删系统核心文件或读取到你的私人照片库。

三、 实战场景一:TXT/Markdown 本地知识库批量归纳

这是最基础但极其有用的场景。假设你是一名项目经理,过去几个月在电脑里零散记录了 50 份 TXT 格式的会议纪要,现在你想让 AI 把它们整理成一份体系化的项目总结。

💡 批量文本处理主控指令 (SOP Prompt):

【任务指令】:批量读取会议纪要并生成项目总结。

【工作目录】:`D:\AI_Workspace\Meeting_Notes\`

**执行步骤:**

1. 调用 FileSystem 插件,遍历工作目录下所有的 `.txt` 和 `.md` 文件。

2. 逐个读取文件内容。在读取过程中,重点提取关于“Alpha 项目”的进度、延期原因和最终决策。

3. 如果文件数量过多导致上下文快满,请在内存中先进行局部总结(Map-Reduce 策略)。

4. 将提取出的所有碎片化信息进行时间线排序,并合并重写。

5. 生成一份结构化的 Markdown 报告《Alpha项目复盘总结.md》,并保存在工作目录的根节点下。

这个过程在 OpenClaw 的终端里极具观赏性。你会看到 Agent 不断触发 [Action: ReadFile],迅速消化几十个文件,并在短短 3 分钟内输出一份极具深度的报告,为你节省了半天的交叉比对时间。

四、 实战场景二:PDF 合同/简历的海量定向解析 (含 OCR)

处理 PDF 是企业办公最大的痛点,尤其是扫描版的 PDF 合同或发票,里面的文字甚至无法直接用鼠标复制。借助 Document Parser 插件,OpenClaw 可以像人类一样“看图识字”。

假设你是一名 HR,刚收到了一个文件夹,里面塞满了 200 份杂乱无章的 PDF 简历,你需要找出所有拥有“5 年以上 Python 经验且期望薪资低于 20k”的候选人。

【任务指令】:HR 简历库定向大搜查与信息结构化。

【目标路径】:`D:\AI_Workspace\Resumes_2026\`

**执行步骤:**

1. 获取目录下所有 `.pdf` 格式的简历列表。

2. 循环处理每一份 PDF:

- 调用 Document Parser 解析 PDF。如果检测到是扫描件,请自动触发 OCR 识别模块。

- 在简历中寻找以下三个关键字段:【候选人姓名】、【Python实际工作年限】、【期望薪资】。

3. 进行逻辑判断:只筛选出“Python年限 >= 5” 且 “期望薪资 <= 20000”的候选人。

4. 将符合条件的候选人数据,以标准的 CSV 格式化文本输出。

5. 最后调用 FileSystem 插件,在桌面上新建一个 `筛选结果.csv` 文件,并将数据写入。

如果在执行过程中,遇到诸如“简历页数过多”导致超时的问题,你可以参考我们的 《OpenClaw Error 500 排障指南》,在指令中增加“仅解析 PDF 前 2 页”的限制条件。

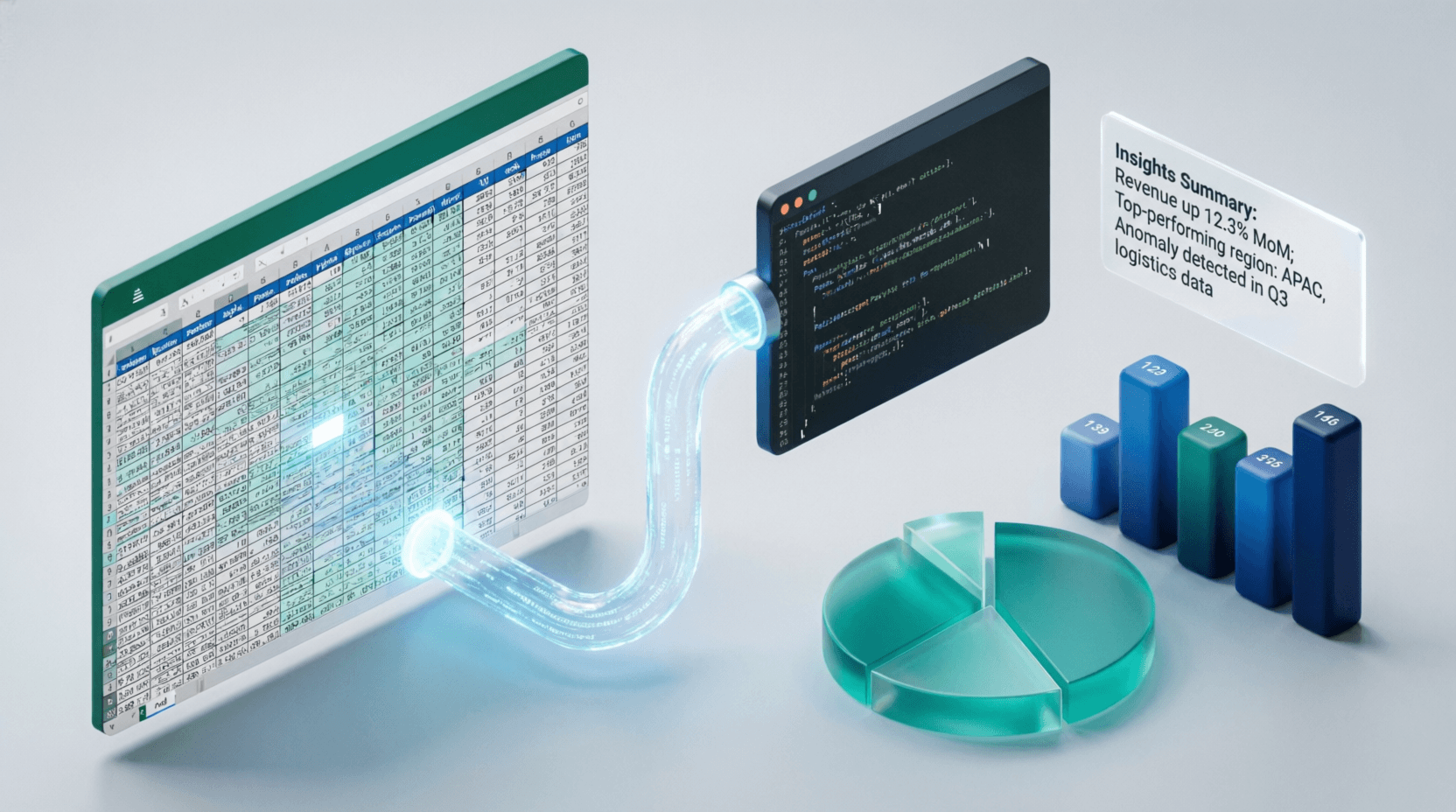

五、 实战场景三:超大型 Excel 的 Python 自动化分析

这是 OpenClaw 区别于任何聊天框 AI 的“王牌杀手锏”。对于一份拥有 100,000 行销售数据的 Excel 表格,把所有数据扔给大模型是不可能的(会瞬间耗尽几十万 Token 甚至死机)。

正确的逻辑是:让大模型充当“程序员”,写一段 Python 代码在本地读取这个 Excel,算出结果后再把简短的结论告诉大模型。

【任务指令】:Q3 季度销售数据深度洞察与图表生成。

【数据源】:`D:\AI_Workspace\Sales_Q3_Data.xlsx` (注:该表包含 15 万行交易数据,列名包括'订单日期','省份','产品类目','销售额')

**执行步骤:**

1. 严禁直接读取整个表格文件!

2. 调用 Python Executor 插件。编写一段 Python 代码 (使用 pandas 库)。

3. 代码需要完成以下逻辑:

- 读取该 Excel 文件。

- 按 '省份' 进行 GroupBy,计算出总 '销售额' 最高的 Top 3 省份。

- 计算这 15 万单的平均客单价。

- 使用 matplotlib 生成一张呈现各产品类目销售占比的饼图,保存为 `D:\AI_Workspace\category_pie.png`。

4. 执行这段代码。

5. 获取 Python 返回的终端结果(Top 3 省份和客单价数字),用专业数据分析师的口吻,为我写一段分析摘要。

奇迹发生了:OpenClaw 会在后台迅速生成一个 temp_script.py,调用你电脑 CPU 进行极速运算。原本网页端无法处理的十万级大表,在几秒钟内就被计算完毕,一张漂亮的饼图直接出现在了你的本地文件夹里!

六、 进阶黑科技:利用本地向量库搭建 RAG (检索增强生成)

如果你有一个包含 5000 份技术规范文档的庞大文件夹,即便使用批量解析,每次问问题都把 5000 份文件读一遍也是极不现实的。这时候,你需要搭建个人版 RAG(Retrieval-Augmented Generation)。

- 在 OpenClaw 中安装

Local Vector Database(本地向量数据库,如 ChromaDB) 插件。 - 下达建库指令:

“请遍历 D:\My_Docs 文件夹,将里面所有的 PDF 和 Word 切片(Chunking),并转换为向量索引保存到本地知识库中。” - 这个过程可能需要挂机几小时。完成后,你的 OpenClaw 就拥有了这 5000 份文档的“超级记忆”。

- 日常对话时:

“根据我的本地知识库,公司去年的服务器采购标准里,内存的最低要求是多少?”OpenClaw 会在 1 秒内从向量库中锁定那一份文件的那一段话,并给出精准答复,彻底解决大模型的幻觉问题!

七、 常见报错与断线排障 (Troubleshooting)

在进行大规模文件 I/O (输入/输出) 操作时,本地环境极其容易出现以下报错:

报错 1:Permission Denied (权限被拒绝)

原因: 试图读取被其他程序占用(比如你正用 Excel 打开着它)的文件,或者试图读取系统 C 盘的受保护目录。

解决: 确保解析前关闭相关文件。在 Windows 上,切勿让 AI 随意扫描 C:\Windows 或 Program Files 目录。如果有必要,尝试以管理员身份重启 OpenClaw(详见 Windows 一键包教程)。

报错 2:Python 脚本报错 "ModuleNotFoundError: No module named 'pandas'"

原因: 你的电脑环境中缺少执行大模型生成的 Python 代码所需的第三方库。

解决: 如果你是在 Docker 中运行,请在容器中执行 pip install pandas matplotlib pdfplumber。如果是一键安装包,请在提示词中加入防呆指令:“如果缺少库,请先执行 `!pip install [库名]` 再运行代码”。

报错 3:乱码问题 (UnicodeDecodeError)

原因: 国内早期的 TXT 或 CSV 文件往往采用 GBK 编码,而 OpenClaw 默认使用国际通用的 UTF-8 尝试读取,导致乱码崩溃。

解决: 这是一个极高频的坑。务必在你的主控 Prompt 中加上一句话:“在读取本地文本或 CSV 文件时,如果遇到解码错误,请主动尝试使用 `gbk`、`gb18030` 或 `utf-8-sig` 编码重新读取。”

八、 常见问题解答 (FAQ)

Q1: 用大模型解析这么多文件,API 的费用会不会非常昂贵?

是的,如果将几千个文件的纯文本内容全部塞给 OpenAI 的 GPT-4o,费用会非常惊人。这就是为什么我们在第五节强调用 Python 代码代替直接阅读,以及在第六节引入 RAG 向量库的原因。这两种方法都能将 Token 消耗降低 99%。当然,最省钱的方法是搭配我们之前的 《Ollama 离线大模型教程》 彻底零成本运行。

Q2: 它可以直接修改我原来的 Excel 吗?

可以。如果你在指令中要求:“将分析结果作为新的一列(如‘客户评级’)写入原先的 Excel 中并覆盖保存”,Python Executor 完全可以做到。但为了数据安全,强烈建议让 AI “将结果输出为一份新的文件(如 `result_v2.xlsx`)”,避免代码错误损毁原始数据。

Q3: 它可以识别图片里的文字吗(比如包含发票的文件夹)?

可以。只要你接入的底层大模型具备 Vision(视觉)能力(如 Claude 3.5 Sonnet 或 GPT-4o),你就可以让 FileSystem 插件直接将 `.jpg` 或 `.png` 格式的发票图片喂给 Agent,让它输出结构化的报销清单表格。

结语:从信息孤岛到智慧大脑

在学会了使用 OpenClaw 批量解析本地文件后,你的电脑就不再是一个仅仅用来存储数据的“冷冰冰的仓库”。它变成了一个鲜活的、对你的过往经验和业务数据了如指掌的“超级大脑”。

无论是跨境电商用来分析海量评论,还是金融量化用来扫描历史财报,熟练掌握“本地文件 I/O + Python 自动化”这一套组合拳,是你成为真正 AI 极客的必经之路。

👉 进阶高能预告:

既然大模型这么会写 Python 脚本帮我们分析数据,那我们能不能让它直接接管整个软件开发流程?敬请期待我们下一篇颠覆开发者认知的重磅长文:《OpenClaw 写代码:替代 Cursor 的本地极客编程助手》,带你体验什么叫一句话生成整个 App!