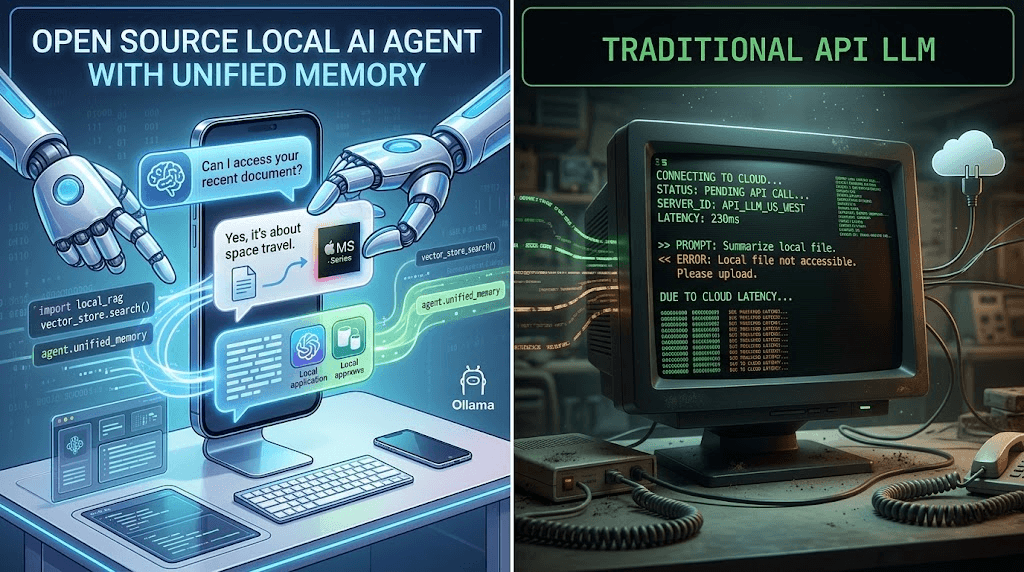

在使用 OpenClaw 打造个人自动化助理的过程中,最大的痛点往往不是如何配置系统,而是每个月看着不断攀升的 OpenAI 或 Claude API 账单发愁。一个活跃的 AI Agent(智能代理)为了维持思考循环(Thinking Loop)、进行自我纠错和调用各种工具,每天可能要消耗掉数以百万计的 Token。

除此之外,许多企业用户和极客玩家对数据隐私有着极高的要求。如果你想让 OpenClaw 帮你整理公司的财务报表、阅读私密的个人日记,或者审查尚未开源的商业代码,将这些数据上传到云端 API 显然是极其危险的。

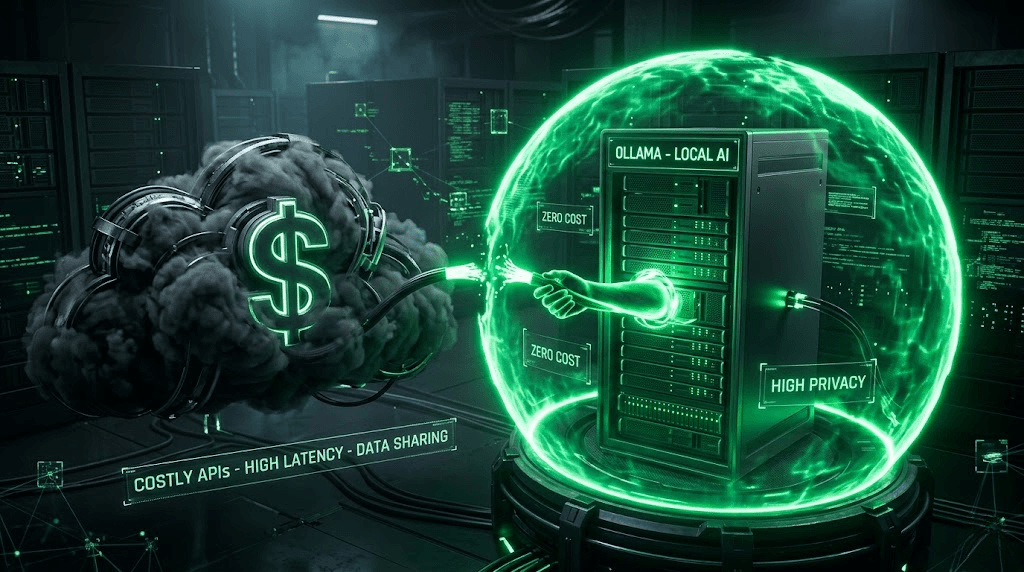

有没有一种方法,既能享受 OpenClaw 强大的自动化生态,又能彻底拔掉网线,实现真正的“零成本、绝对隐私”?答案就是:结合本地大模型神器 Ollama。本文将带你全面解析如何在完全离线的状态下,将 OpenClaw 与 Ollama 完美缝合,打造一个电费即网费的“永动机”助理。

一、 为什么选择 Ollama 作为 OpenClaw 的本地大脑?

目前市面上有诸多本地大模型运行框架,如 LM Studio、vLLM、Text-generation-webui 等,但 OpenClaw 官方明确将 Ollama 列为第一优先级的本地部署方案,原因有三:

- 极简的 API 兼容性: Ollama 默认提供的

11434端口 API 完全兼容 OpenAI 的请求格式。这意味着 OpenClaw 的底层逻辑无需任何修改,就能像调用 ChatGPT 一样调用本地模型。 - 跨平台且资源优化极佳: 无论你是使用我们之前介绍过的《OpenClaw Windows 一键包》,还是在 M 芯片上参考《Mac 原生运行指南》,Ollama 都能自动识别你的硬件,优先使用 GPU 或 NPU 进行加速。

- 模型量化管理方便: 你不需要去 HuggingFace 费力寻找各种

.GGUF文件。Ollama 的模型库就像 Docker Hub 一样,一行命令即可拉取经过 INT4 极限压缩的优质模型,最大程度节省你的显存。

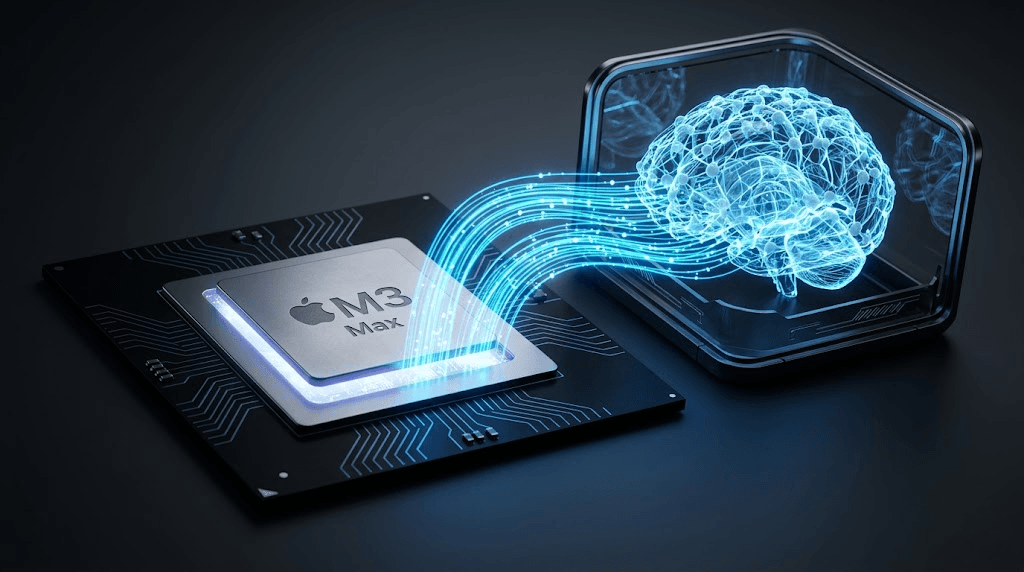

二、 离线运行的硬件配置天梯图:你的电脑能跑什么模型?

在开始之前,我们必须打破一个幻觉:本地大模型虽然不要 API 费用,但它对你的电脑硬件(特别是显存 VRAM 和 内存 RAM)要求极高。如果强行运行超出硬件承受能力的模型,不仅速度慢如蜗牛,还容易导致 OpenClaw 报错 500 断联。

以下是经过 OpenClaw 社区实测的本地硬件配置与模型选择天梯图:

三、 安装 Ollama 并拉取最强 Agent 模型

步骤 1:安装 Ollama 客户端

前往 Ollama 官方网站 (ollama.com) 下载对应操作系统的安装包。安装过程一路点击下一步即可。安装完成后,Ollama 会在系统后台默默运行。

步骤 2:挑选并拉取模型 (核心环节!)

不是所有的 LLM 都适合做 Agent。有些模型虽然写文章很厉害,但它们“听不懂” OpenClaw 发送的 JSON 格式的工具调用指令(Function Calling)。为了保证 OpenClaw 能够正常使用插件,你必须选择经过工具调用微调的模型。

🏆 2026年 OpenClaw 本地模型推荐榜:

- Qwen 2.5 (通义千问系列): 目前开源界最强 Agent 模型。不仅中文原生支持极好,且 Function Calling 能力极强。

- Llama 3.1 系列: Meta 开源标杆,英文逻辑推理无敌,但中文偶尔会夹杂英文。

打开你的终端(Windows 为 PowerShell,Mac 为 Terminal),执行以下命令拉取模型(以 16GB 内存电脑拉取 Qwen2.5 7B 为例):

ollama run qwen2.5:7b第一次运行会下载约 4GB 的模型文件,请耐心等待。下载完成后,终端会出现一个 >>> 的聊天提示符,此时你可以输入“你好”测试模型是否正常运行。测试完毕后输入 /bye 退出,但请确保 Ollama 软件依然在系统托盘运行。

四、 手把手:将 OpenClaw 对接至本地 Ollama

现在本地大脑已经就绪,我们需要让 OpenClaw 的控制面板指向这个大脑,从而摆脱云端 API 依赖。

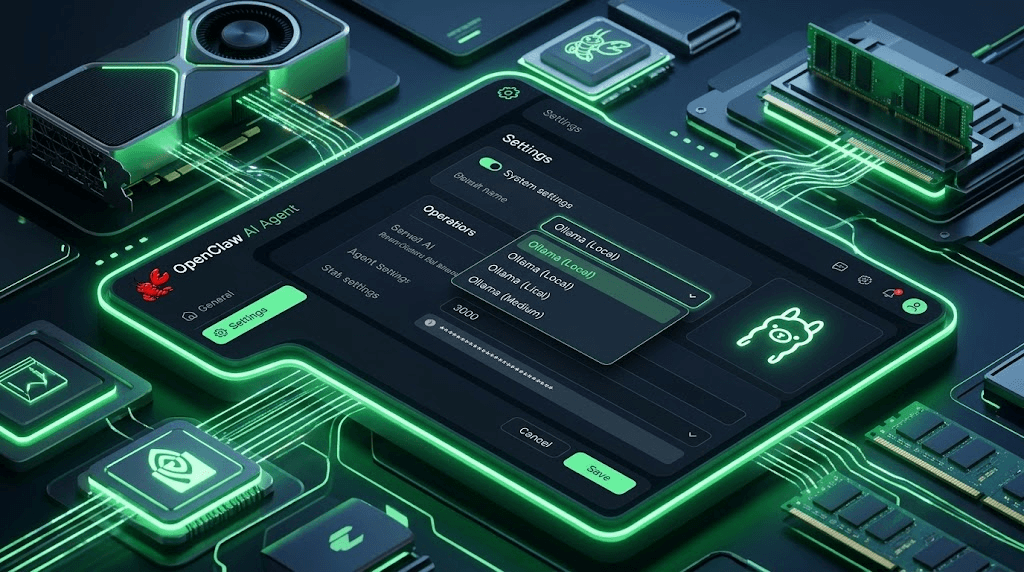

1. 在 OpenClaw Web UI 中进行配置

- 启动您的 OpenClaw,打开浏览器进入 Web UI 控制面板(通常为

http://localhost:18789)。 - 点击左下角的 ⚙️ Settings (设置),进入 LLM Provider (模型提供商) 选项卡。

- 在 Provider 下拉菜单中,将默认的

OpenAI改为Ollama (Local)。

2. 填写关键参数

在这个界面中,你需要极其准确地填写以下三个参数:

- Base URL (基础地址): 填写

https://www.jumei.ai/api或者http://localhost:11434/api。这是 Ollama 默认监听的本地端口。 - Model Name (模型名称): 必须与你刚才在终端拉取的名称完全一致!例如输入

qwen2.5:7b。不要多加空格。 - Context Window (上下文窗口): 建议设置为

8192。如果你内存很小,可以降低到4096,但这会影响 AI 记忆长对话的能力。

3. 保存并测试

点击界面上的 Test Connection (测试连接) 按钮。如果弹出绿色的“Successfully connected to local model”,恭喜你,你的本地自动化帝国已经成功建立!

五、 进阶调优:让本地模型发挥 120% 的战斗力

本地模型由于参数量远小于 GPT-4o,往往需要更加精细的调教才能达到极佳的自动化效果。

1. 降低 Temperature (温度值)

Agent 在执行任务(如写代码、执行终端命令)时,需要的是绝对的精准,而不是天马行空的创意。在 OpenClaw 的 Advanced Settings (高级设置) 中,找到 Temperature 选项,将其从默认的 0.7 降低到 0.1 或 0.2。这能有效避免本地模型胡乱捏造不存在的终端命令。

2. 修改 System Prompt (系统提示词) 增强指令感

如果你的本地模型(例如 7B 级别的小模型)经常忘记调用工具,只会陪你聊天。你可以在系统设置的 Custom System Prompt 中加入这句强力约束(中文或英文皆可,视模型主力语言而定):

"你是一个完全自主的系统管理员。当用户提出需求时,你必须优先思考使用你的 AgentSkills 工具(如 shell, browser)来解决问题,而不是仅仅给出建议。请严格输出正确的 JSON 工具调用格式。"

3. 开启“保持模型常驻内存” (Keep Alive)

Ollama 默认会在闲置 5 分钟后将模型从显存中卸载,以节省资源。这会导致 OpenClaw 每次接到新任务时,都要重新加载几 GB 的模型,响应极慢。你可以通过修改环境变量,强制模型常驻:

# 在终端中设置环境变量并重启 Ollama 服务

export OLLAMA_KEEP_ALIVE=24h六、 常见离线运行故障排错 (Troubleshooting)

故障 1:点击测试连接提示 "Failed to fetch" 或 "Connection Refused"

原因: Ollama 服务未启动,或者 OpenClaw 运行在 Docker 中,无法直接通过 localhost 访问宿主机的 11434 端口。

解决办法: 如果 OpenClaw 在 Docker 中,请将 Base URL 中的 localhost 更改为宿主机的局域网 IP(例如 http://192.168.1.100:11434/api)。并在宿主机设置 Ollama 允许跨域及外部访问(设置环境变量 OLLAMA_HOST=0.0.0.0)。

故障 2:AI 开始疯狂重复同一句话,陷入无限死循环

原因: 这是典型的小尺寸模型“复读机效应”,或者是因为 Context Window 溢出导致模型忘记了之前的工具执行结果。

解决办法: 点击界面上的“Stop Agent”强行中止任务。点击右上角的“Clear Memory”清空本轮对话上下文。尝试调高一点点 Temperature(比如加到 0.3),或者更换参数量更大的模型(从 8B 换到 14B)。

故障 3:模型推理时电脑卡顿、鼠标掉帧

原因: 你的模型体积过大,Ollama 将一部分模型数据加载到了慢速的硬盘虚拟内存(Swap)中。这也叫“爆显存”。

解决办法: 放弃当前模型,运行 ollama rm [模型名] 删除它。重新拉取体积更小的量化版本,例如将 qwen2.5:32b 降级为 qwen2.5:7b。

七、 常见问题解答 (FAQ)

Q1: 断网后,OpenClaw 的网页搜索 (Web Search) 技能还能用吗?

不行。虽然你的大脑(Ollama 模型)和身体(OpenClaw 核心程序)都在本地,但如果你拔掉了网线,需要联网的 AgentSkills(如网页爬虫、发送邮件、查询天气)都会报错。断网状态下,OpenClaw 只能执行读取本地文件、运行本地脚本、整理本地磁盘等纯本地任务。

Q2: 我可以同时接入 OpenAI 和本地 Ollama,让它们协同工作吗?

未来的 OpenClaw 2.0 版本有规划“多模型混合路由”功能(例如简单的任务让本地模型处理,遇到极度复杂的代码交给云端 GPT-4o)。但在当前版本中,你同一时间只能在 Settings 中激活一个主要的 LLM Provider。

Q3: 为什么我的本地模型用命令行工具时总是出错?

本地小模型对 Shell 命令的掌握程度不如云端巨无霸。建议在运行涉及 rm, sudo, 或批量重命名的破坏性指令时,务必在 OpenClaw 的安全设置中开启 Human-in-the-loop(人工确认),即 AI 每次敲回车前,都会弹窗等待你的批准,防止本地系统被 AI 误删。

结语:实现真正的 AI 数字主权

将 OpenClaw 成功对接本地 Ollama,标志着你跨入了 AI 极客的更高阶殿堂。你不再受制于云端 API 的额度限制,也不用担心隐私数据被用于训练其他模型。在这台电脑里,你拥有一个绝对忠诚、免费且永不停歇的数字员工。

👉 进阶阅读预告:

搞定了免费的本地大脑后,如何让它成为生产力工具?敬请关注我们的下一篇教程:《OpenClaw 最好用的 10 个神级 Skill 插件库推荐》。我们将教你如何安装各类自动化工具,让 AI 真正接管你的日常繁琐工作!