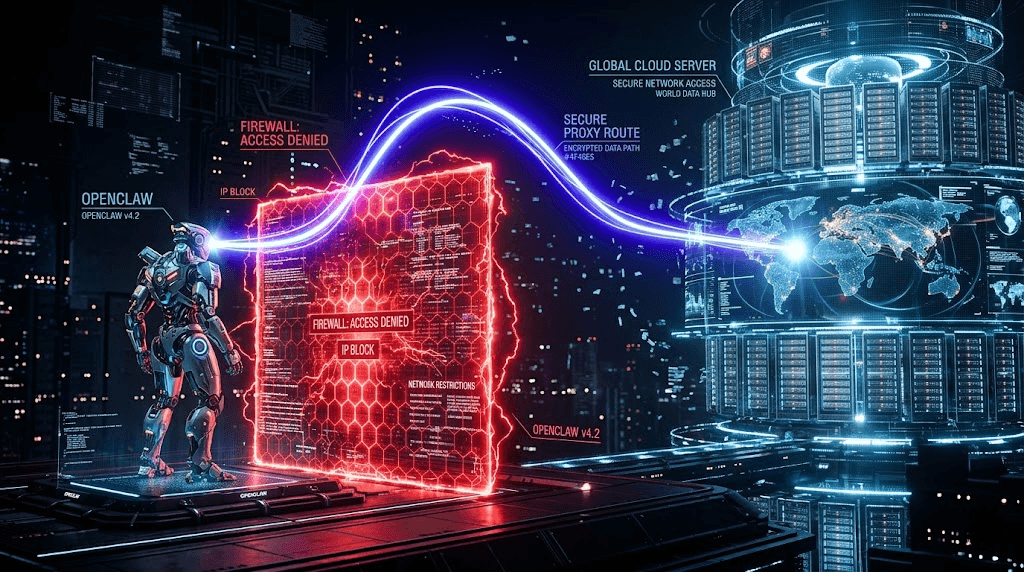

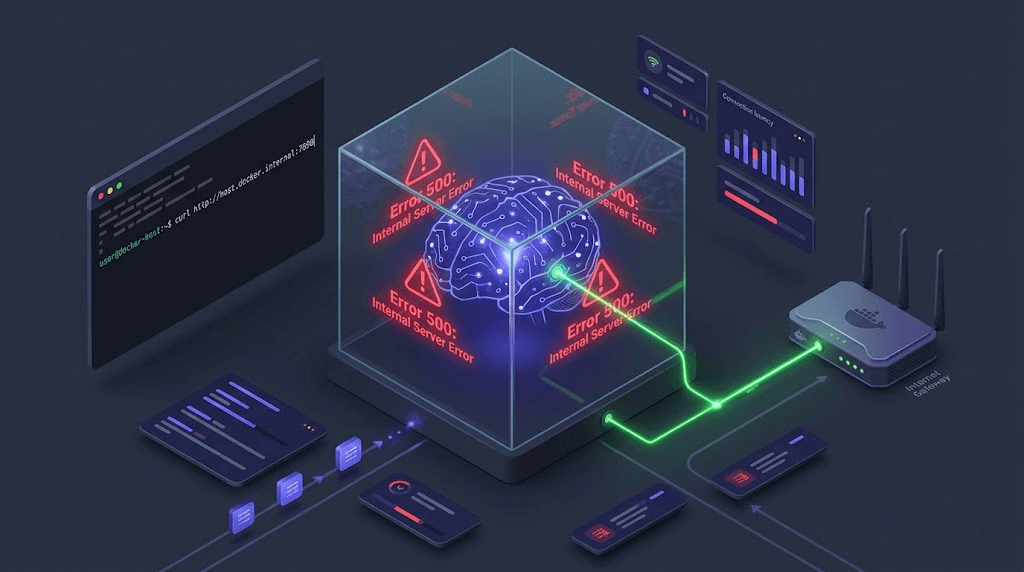

对于一款需要不断“思考”和“行动”的 AI Agent 来说,网络就是它的呼吸管。不管你的 代码自动化能力 有多强,或者你的 跨境电商数据抓取脚本 写得多完美,一旦 OpenClaw 连不上网,它就会变成一块毫无用处的废铁。

很多国内用户在配置 OpenClaw 时,最常遇到的挫折就是:明明我的电脑浏览器可以正常打开 Google 和 ChatGPT,为什么 OpenClaw 却疯狂报错 "ETIMEDOUT" 或者 "ECONNREFUSED"?

这是因为 OpenClaw 的底层通常基于 Node.js 或 Python 运行,这些后端运行环境并不会默认继承你电脑浏览器或系统的代理设置。它们需要你进行专门的“网络路由指引”。

本文将为你提供一份终极的 OpenClaw 网络与代理排障大全。无论你是使用本地一键包还是 Docker 容器,无论你遇到的是 API 超时还是 TLS 证书拦截,这里都有最硬核、最直接的解决方案。

一、 症状诊断:是“大脑断连”还是“手脚断连”?

在开始敲代码修改配置前,你需要搞清楚是 OpenClaw 的哪个部位断网了,这决定了排错的方向。请观察控制台日志(Terminal Logs):

- 症状 A(大脑断连): 报错出现在你点击 `Start Agent` 或发送消息的瞬间。典型日志为

Failed to fetch LLM Provider: OpenAI / Anthropic。这说明 OpenClaw 连不上大模型 API 服务器。 - 症状 B(手脚断连): 大模型回复正常,但当它试图调用

Web Scraper插件抓取海外网页,或者调用Terminal执行git clone时报错超时。这说明大模型通信正常,但 Agent 执行具体网络任务时被墙了。

二、 核心解法:配置正确的全局代理 (HTTP_PROXY)

要解决上述 90% 的网络问题,最直接的方法就是为 OpenClaw 注入环境变量,强行接管它的网络请求。

1. 获取你本地的代理地址与端口

打开你电脑上的科学上网软件(如 Clash, V2ray, Shadowrocket)。找到局域网设置 (LAN) 或入站端口 (Inbound Port)。通常情况下,Windows/Mac 的本地代理地址默认是:

- HTTP 代理:

https://www.jumei.ai - SOCKS5 代理:

socks5://127.0.0.1:7890(部分软件端口可能为 1080或 10808)

2. 将代理注入 OpenClaw 的 .env 文件

找到 OpenClaw 安装目录下的 .env 文件(如果没有,复制 .env.example 重命名为一个)。使用记事本打开,在文件最末尾加入以下三行代码(请替换为你的实际端口):

HTTP_PROXY="https://www.jumei.ai"

HTTPS_PROXY="https://www.jumei.ai"

NO_PROXY="localhost,127.0.0.1,0.0.0.0,::1"注意: NO_PROXY 这一行极其重要!它的作用是告诉 OpenClaw:当你连接本地数据库、本地 Web UI 或者 本地的 Ollama 模型 时,不要走代理,否则会导致本地服务全部无法访问(一直 Loading 卡死)。

保存文件后,完全重启 OpenClaw(如果使用 PM2 请执行 pm2 restart all)。

三、 Docker 部署用户的专属网络“天坑”

如果你是用 Docker 部署的 OpenClaw,按照上面的 127.0.0.1 配置,绝对连不上网。

原因解析: Docker 容器内部是一个完全隔离的虚拟操作系统。在 Docker 里面写 127.0.0.1,指的是 Docker 容器自己,而不是运行着代理软件的宿主机(你的电脑)!

🛠️ Docker 网络穿透修复方案:

方案 A:使用 host.docker.internal (推荐 Windows/Mac 用户)

Docker Desktop 提供了一个特殊的域名来指向宿主机。你需要将 .env 文件中的代理地址改为:

HTTP_PROXY="http://host.docker.internal:7890"

HTTPS_PROXY="http://host.docker.internal:7890"(注意:此时你必须在代理软件中开启“允许局域网连接 / Allow LAN”,否则代理软件会拒绝来自 Docker 的请求。)

方案 B:使用 Host 网络模式 (推荐 Linux/VPS 用户)

如果你在 Linux 服务器上使用 docker run 启动,可以直接加上 --network host 参数。这样容器会直接共享服务器的网络栈,此时你就可以像本地安装一样使用 127.0.0.1 了。

docker run -d --network host --name openclaw ghcr.io/openclaw/openclaw:latest四、 高级排错:TLS 证书拦截与 HTTPS 报错

在配置好代理后,很多用户发现网络通了,但报错变成了:UNABLE_TO_VERIFY_LEAF_SIGNATURE 或 self signed certificate in certificate chain。

原因解析: 这是因为你的代理软件(为了实现某些路由规则)对 HTTPS 流量进行了“中间人攻击(MITM)”,下发了它自己伪造的 SSL 证书。而 Node.js 默认极其严格,它发现证书不是官方的,就会强行切断连接以防黑客窃听。

🛠️ 终极解法:关闭 Node.js 的证书强制校验

再次打开你的 .env 文件,加入这个“魔法变量”:

# 忽略未授权的 TLS 证书 (危险但在使用代理时必须开启)

NODE_TLS_REJECT_UNAUTHORIZED=0加入后重启,99% 的 HTTPS 拦截报错都会瞬间消失,你的 OpenClaw 将彻底畅通无阻。

五、 常见报错代码极速对照表 (Cheat Sheet)

六、 常见问题解答 (FAQ)

Q1: 配置了 HTTP_PROXY,为什么 Puppeteer(无头浏览器)插件还是打不开海外网页?

这是一个典型的“环境变量不继承”问题。OpenClaw 主程序的 .env 代理有时无法传递给它启动的 Chromium 浏览器进程。你需要进入 OpenClaw 的 Skill Market -> Web Scraper 设置 中,专门寻找“Browser Proxy Argument”一栏,填入 --proxy-server=https://www.jumei.ai 才能让爬虫插件生效。

Q2: 我用的是国内的大模型(如智谱、文心一言),还需要配置代理吗?

不需要!如果你在 Settings 中将 LLM Provider 切换到了国内的大模型 API(如 ZhipuAI / Baidu),它们在国内是直连的。如果你为了挂着代理翻墙,却忘记在 NO_PROXY 里排除国内大模型的域名,反而会导致请求绕地球一圈,造成极高的延迟。

Q3: 我可以单独为某一个 Plugin (插件) 配置代理吗?

目前的 OpenClaw 架构支持细粒度路由。如果是官方支持的优质插件,通常会在该插件的独立设置面板(Settings)中提供 Proxy URL 字段。填写该字段后,仅该插件的流量会走代理,主程序的其他流量走直连,这是最稳妥的架构。

结语:打通 AI 连接世界的桥梁

网络问题往往是摧毁新手热情的最后一块绊脚石。当你掌握了 HTTP_PROXY 的配置原理、理解了 Docker 的网络隔离、并学会了用 NODE_TLS_REJECT_UNAUTHORIZED=0 解决证书冲突后,你不仅解决了 OpenClaw 的问题,你也掌握了所有 Node/Python 后端项目网络排障的万能钥匙。

一旦网络畅通,你的 OpenClaw 就像一头解开枷锁的猛兽,随时准备为你抓取全网的数据并创造价值。

👉 高阶学术应用预告:

解决了网络问题,让我们来干点极度硬核的事!如果让你在一个晚上完成硕士论文的初稿,AI 能做到吗?敬请关注下一篇重磅干货:《OpenClaw 写论文:文献检索与文献综述自动生成》,带你体验学术自动化的降维打击!