Key Takeaways

- OpenClaw Skills 教程的重点不是多装工具,而是把可重复任务写成清楚、可审查、可维护的执行说明。

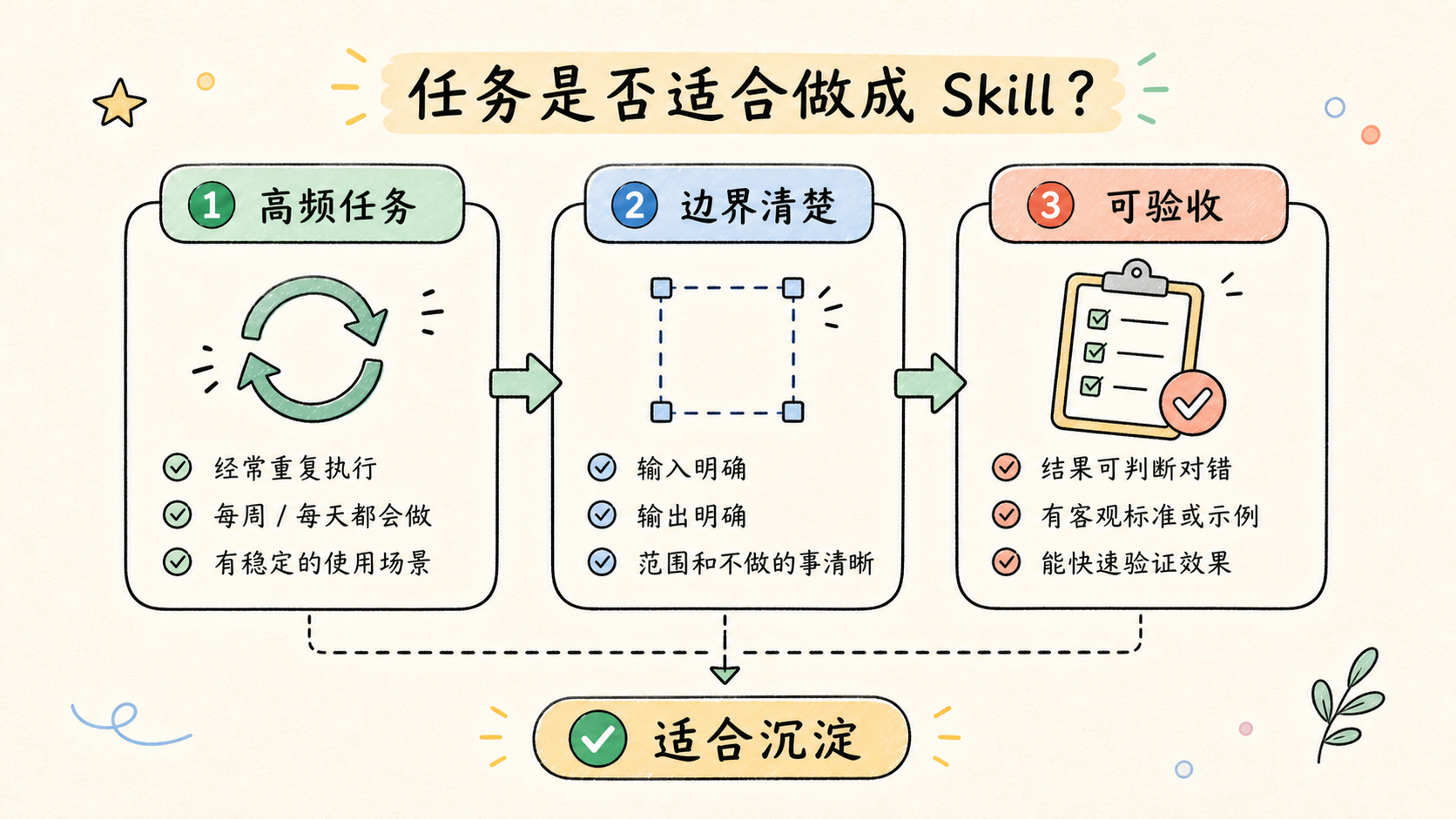

- 适合做成 Skill 的任务,一般具备高频、稳定、可验收三个特征。

- 安装后不要直接用于关键任务,先做低风险试运行,再决定是否进入团队流程。

- 自己写 Skill 时,先写一个窄场景,再补触发条件、禁止事项和验收标准。

OpenClaw Skills 教程,简单说就是教你把一类重复工作沉淀成 AI 可以理解的操作规范。它通常包含三件事:安装已有 Skill,审查这个 Skill 是否适合当前项目,再把团队自己的流程写成新的 Skill。读这篇 OpenClaw Skills 教程 时,可以把重点放在“复用边界”和“验收方法”上。

这件事适合有固定流程的团队。比如内容生产、SEO 检查、代码审查、社媒矩阵复盘、客户交付检查。它不适合还在探索的流程。如果负责人自己也说不清标准,先写普通文档,比直接写 Skill 更稳。OpenClaw Skills 教程要解决的是复用问题,不是替团队临时发明流程。

对 jumei 这类面向海外社媒矩阵运营的业务来说,Skill 可以理解成“AI 执行前的 SOP”。它不能替代负责人判断,但能减少重复交接。团队只要把规则写清楚,后续执行和复查就更容易统一。

OpenClaw Skills 教程开始前:先判断适不适合

先做判断,再谈安装。很多人一上来就找 Skill、装 Skill、改 Skill,但真正的问题是:这个任务值不值得被沉淀。OpenClaw Skills 教程如果用于团队流程,第一步也应该是判断适配度。

| 判断项 | 适合做成 Skill | 暂时不适合 |

|---|---|---|

| 任务频率 | 每周、每月都会重复 | 只做一次 |

| 流程边界 | 步骤和禁止事项清楚 | 还在试错 |

| 输出要求 | 格式、检查项稳定 | 每次都完全不同 |

| 团队协作 | 多人要按同一标准做 | 只有一个人偶尔用 |

| 风险控制 | 能写出停止条件 | 出错后没人复查 |

如果一项任务只是临时需求,用普通提示词就够了。如果它经常出现,而且每次都要重复解释标准,就适合进入 OpenClaw Skills 教程里的 Skill 化流程。

一个实用判断是:能不能写出“输入、步骤、输出、验收”。写不出来,就先别写 Skill。先把人工流程跑一遍,记录哪里容易错,再决定是否沉淀。

在团队运营里,这和 Jumei 工作方式 的思路一致:先把流程跑通,再考虑复用和自动化。

前置准备:不要空手写 Skill

写 Skill 前,至少准备四类材料。

| 材料 | 要回答的问题 | 示例 |

|---|---|---|

| 任务说明 | 这个 Skill 解决什么问题 | 检查 jumei 文章是否符合入库规范 |

| 触发条件 | 什么时候应该使用 | 用户说“生成 jumei 文章” |

| 禁止事项 | 哪些动作不能做 | 不能跳过 publish-check |

| 验收标准 | 什么结果算完成 | ready=true 且质量门槛通过 |

这里最容易漏掉的是禁止事项。很多 Skill 输出不稳定,不是因为步骤少,而是因为边界没写清楚。比如不能使用 stub 生成正式文章,不能手改标题库固定标题,不能把中文文章写成英文销售页。OpenClaw Skills 教程里的“禁止事项”应该写成硬边界,而不是写成建议语气。

如果你要把 Skill 用在社媒矩阵或内容生产中,还要提前想清楚权限。谁能改规则,谁能审查结果,谁负责在流程变化后更新 Skill。没有维护人,Skill 很快会变成过期文档。

参考官方文档时,也要保持克制。OpenAI 的 prompting 指南强调给模型提供背景和清楚任务,GitHub 的 README 文档也强调项目说明能帮助协作者理解预期。写 Skill 的底层逻辑类似:让下一个执行者更快理解任务,而不是让规则看起来复杂。这个原则也是 OpenClaw Skills 教程 反复强调的基础。

参考链接:

OpenClaw Skills 教程核心步骤:安装、审查、编写

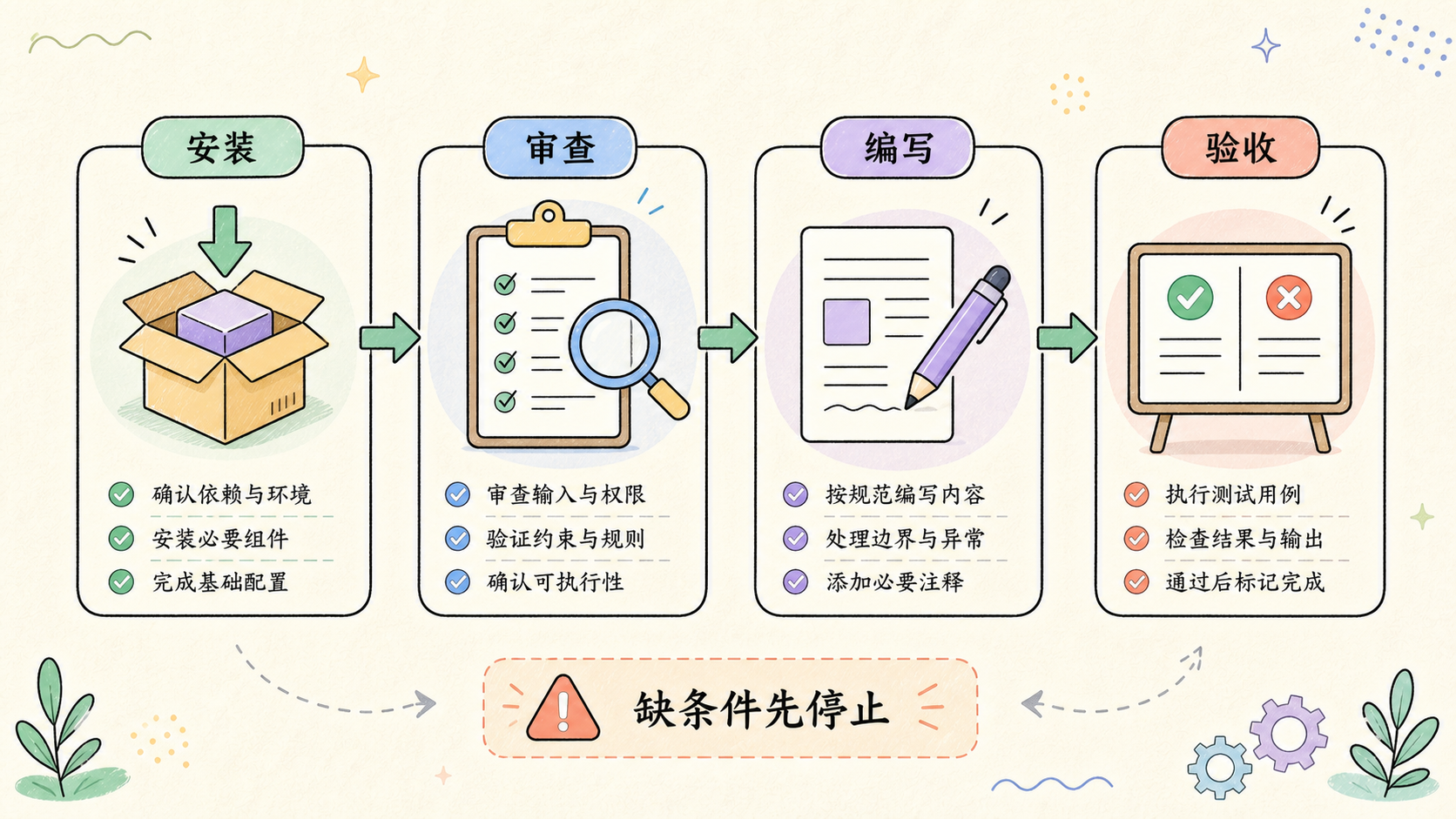

这一节按实际顺序走。不要跳过审查。

- 确认来源:先看 Skill 来自哪里,是否适合当前项目。

- 阅读说明:看触发条件、适用范围、禁止事项和输出格式。

- 低风险试运行:先用样例任务测试,不要直接用于关键发布。

- 记录偏差:输出不符合预期时,记录是输入问题、规则问题,还是 Skill 太宽。

- 决定是否保留:只有稳定、可读、可复用的 Skill 才值得进入团队流程。

- 再写自己的 Skill:从一个窄场景开始,不要一上来覆盖所有业务。

安装已有 Skill 时,重点不是“能不能装上”,而是“默认假设是否匹配”。一个面向代码审查的 Skill,未必适合内容审查;一个面向英文页面的 Skill,也未必适合中文 SEO 文章。OpenClaw Skills 教程在这一步更强调匹配度,而不是安装速度。

审查时重点看四个问题:

- 触发条件是不是太宽。

- 是否可能和项目硬规则冲突。

- 是否写清楚失败时要停止。

- 输出结果是否方便负责人复查。

自己写 Skill 时,先写最小版本。比如“jumei 中文 SEO 文章入库前检查”比“公司全部内容规范”更容易成功。后者范围太大,维护成本也高。OpenClaw Skills 教程更适合用小任务验证,而不是一次覆盖全部流程。

如果你在做海外社媒矩阵,可以把 Skill 和 Jumei 自动化运营 放在同一个执行链路里看:前者负责规则复用,后者负责具体任务执行和流程管理。

常见错误和排查方法

常见错误不是不会写,而是写得太大、太宽、太模糊。

| 错误 | 典型表现 | 修法 |

|---|---|---|

| 没有触发条件 | 模型不知道什么时候用 | 写清用户话术或任务阶段 |

| 一个 Skill 做太多事 | 写作、审查、入库、补图全塞一起 | 拆成多个小 Skill |

| 没有停止条件 | 缺文件也继续编 | 写清失败就停 |

| 禁止事项太少 | 容易越过项目规范 | 把硬规则列成清单 |

| 输出不可验收 | 只说“完成了” | 要求列出检查结果 |

排查时按这个顺序来:

- 先看输入是否完整。

- 再看 Skill 是否读到了必要上下文。

- 再看规则之间是否冲突。

- 最后再改 Skill 本身。

不要一出问题就重写。很多偏差只是输入不完整,或者验收标准没有写清楚。先定位,再小改,通常比推倒重来更稳。

一个停止规则可以这样写:如果规范文件无法读取、目标路径不存在、数据库不可连接、图片出现乱码、标题和关键词冲突,必须停止并报告。这个规则比“尽量做好”更有用。

OpenClaw Skills 教程做完后怎么判断是否成功

判断成功,不看 Skill 写了多长,也不看规则多复杂。OpenClaw Skills 教程的验收重点有三件事:能不能稳定执行,能不能发现错误,能不能被团队复用。

| 验收项 | 通过标准 | 不通过信号 |

|---|---|---|

| 触发清晰 | 用户一句话就能触发正确流程 | 经常用错场景 |

| 执行稳定 | 同类任务结果接近 | 每次风格差很多 |

| 边界明确 | 遇到缺条件会停止 | 缺文件还继续编 |

| 输出可查 | 有文件、报告或数据库结果 | 只有口头说明 |

| 维护可控 | 改一条规则不会影响全部 | 一改就牵连整篇 |

还可以做一次小型复盘。选 3 个真实任务,让不同成员使用同一个 Skill。看他们是否能得到接近的结果。如果只有作者本人能用,说明说明还不够清楚。

对内容团队来说,验收可以更具体:是否先读规范,是否保留固定标题,是否跑 publish-check,是否在入库后确认图片和标题状态。对社媒运营团队来说,可以看账号分组、执行记录、异常处理和复盘字段是否完整。

这类复盘可以结合 Jumei 数据监控分析 的思路:不要只看执行次数,还要看结果是否可解释。

适合谁,不适合谁

适合:

- SEO 内容团队,需要稳定生成、审查和入库流程。

- 工程团队,需要统一代码审查或发布检查口径。

- 海外社媒团队,需要复用账号管理、内容发布、复盘 SOP。

- 交付团队,需要把客户交付检查项固定下来。

不适合:

- 流程还没定,负责人也没有标准。

- 每次任务都完全不同。

- 没有人维护 Skill。

- 想用 Skill 替代人工审查。

- 任务风险高,但没有权限边界。

如果你属于第二类,先写普通流程文档。等流程跑顺,再把相对稳定、容易出错、值得复用的部分提炼成 Skill。这个顺序慢一点,但返工少。

对正在搭建海外社媒执行体系的团队,可以把 Skill 当作 多账号管理 之外的“规则层”。账号、内容、执行、复盘要分清,Skill 只负责让规则更稳定地进入 AI 执行上下文。

常见问题

1. OpenClaw Skills 教程适合新手吗?

适合,但新手不要先写复杂 Skill。先读已有 Skill,理解它怎么写触发条件、边界和验收标准,再从一个小任务开始。

2. OpenClaw 安装后可以直接用于正式任务吗?

不建议。先用低风险样例试运行。涉及发布、数据库、账号环境和批量修改的任务,要先确认停止条件。

3. 自己写 Skill 需要懂技术吗?

未必。更重要的是懂业务流程。你要知道输入是什么、步骤是什么、不能做什么、结果怎么验收。

4. 一个 Skill 应该写多长?

没有固定长度。能清楚说明触发、步骤、禁止事项和验收标准就够。越长未必越好,范围清楚更重要。

5. Skill 和普通提示词有什么区别?

普通提示词适合一次性任务。Skill 适合重复任务,尤其适合多人需要按同一标准执行的场景。

6. OpenClaw 使用教程里最容易忽略什么?

最容易忽略审查。安装和编写只是动作,审查才决定这个 Skill 会不会和项目规范冲突。

7. 结果不好要不要重写?

先不要重写。先查输入、上下文、规则冲突和验收标准。确认结构本身不可维护时,再重写。

8. 团队里谁应该维护 Skill?

最好由业务负责人和实际执行者共同维护。负责人定标准,执行者反馈偏差。只有这样,Skill 才不会变成没人更新的旧文档。

总结

OpenClaw Skills 教程的核心,是把重复任务变成可读、可审查、可复用的执行说明。安装只是开始,审查、试运行和维护才决定它能不能长期使用。

如果你要落地,先选一个小场景:比如文章入库检查、代码审查清单、社媒复盘模板。写清触发条件、输入材料、禁止事项和验收标准。跑通以后,再扩到更复杂的流程。

对 jumei 用户来说,Skill 可以服务内容生产、社媒矩阵、获客引流和复盘分析。想把规则和获客链路连起来,可以结合 Jumei 获客引流 继续梳理:先让流程可复用,再让执行结果可追踪。