OpenClaw API 使用,本质上是把一个可执行的 AI 任务接入到业务系统里:系统发起任务,OpenClaw 根据任务调用工具,执行完成后把结果写回到指定位置。它不是单纯“问 AI 一个问题”,也不是只做一次文本生成,而是让任务、工具、账号、记录和复盘形成一个闭环。

如果团队只是偶尔让 AI 写一段文案,用界面操作可能已经够用。如果团队要把内容生成、社媒运营、账号检查、线索整理、数据回填等动作接进固定流程,就需要 API 方式。API 的价值不在于“更高级”,而在于任务可触发、过程可追踪、结果可回写。

这篇 OpenClaw 教程重点讲三件事:什么时候适合用 API,任务触发和工具调用应该怎么设计,以及结果回写后怎么判断任务真的做对了。为了避免误用,正文会先讲适用边界,再进入步骤。Google Search Central 对“有帮助内容”的定义强调要帮助用户完成真实任务,API 接入也应该服务真实流程,而不是只追求接口可调用:Google Search Central。

Key Takeaways

- OpenClaw API 使用适合有固定流程、明确输入、可验收结果的团队任务。

- 任务触发前要先定义目标、账号环境、工具权限、回写位置和失败处理方式。

- 工具调用不要只看是否执行成功,还要看是否使用了正确账号、正确素材和正确规则。

- 结果回写必须保留状态、时间、负责人、输出内容和异常原因,方便复盘。

- 先用小任务试运行,再接入正式业务流程,通常比一次性全量接入更稳。

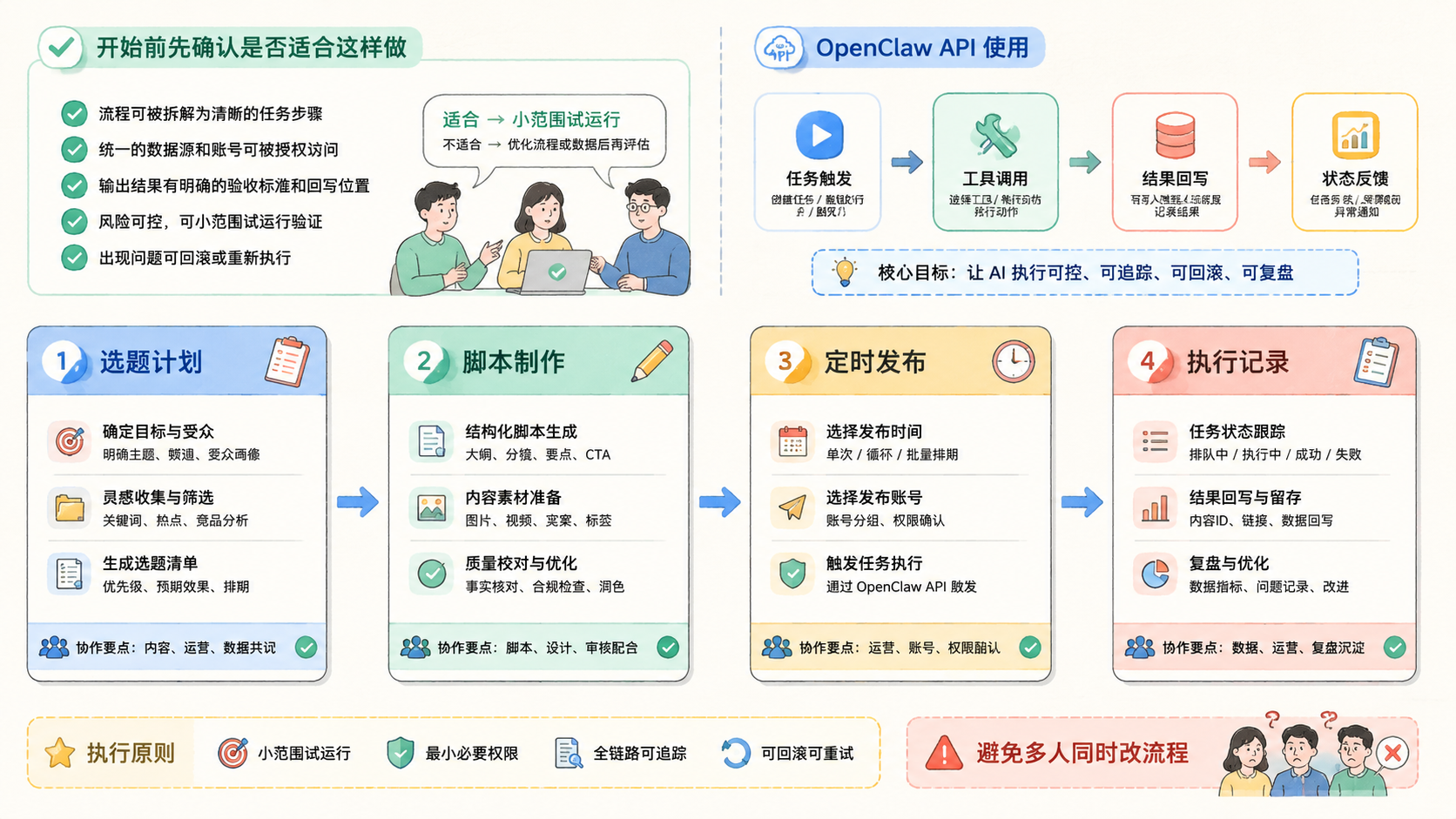

开始前先确认是否适合这样做 and OpenClaw API 使用

不是所有任务都适合 API 化。适合 OpenClaw API 使用的任务,通常有三个特征:输入比较固定,执行步骤可以拆分,结果可以验收。比如每天触发一批内容生成任务、检查一组账号状态、把线索整理到表格、把任务结果回写到 CRM 或运营看板,这类任务更容易形成闭环。

不适合的场景也要先说清楚。如果任务目标经常变化,判断标准完全依赖临场经验,或者结果没有固定接收位置,直接上 API 反而会增加沟通成本。团队会看到很多“已执行”的记录,但不知道这些记录是否真的可用。

可以用一个简单判断表先筛选:

| 判断项 | 适合 API 化 | 暂不适合 API 化 |

|---|---|---|

| 输入 | 有固定字段,如账号、素材、目标、时间 | 每次都靠人工临时描述 |

| 流程 | 能拆成触发、执行、检查、回写 | 步骤经常变化,没有 SOP |

| 工具 | 已知道要调用哪些工具或账号环境 | 工具选择每次都靠人判断 |

| 结果 | 有明确回写位置和验收标准 | 只看“感觉是否不错” |

| 异常 | 能定义失败原因和重试规则 | 失败后只能人工猜原因 |

如果你的团队已经在做海外社媒矩阵运营,API 化通常更有意义。比如账号分组、内容发布、互动记录、线索沉淀、数据复盘都需要统一执行。Jumei 的 工作方式 更接近这种“流程先行”的思路,而不是单点工具拼接。

OpenClaw API 使用前置准备:不要一上来就写接口

真正影响 OpenClaw API 使用效果的,不是第一行代码,而是前置定义是否清楚。API 只是入口,任务背后的账号环境、执行权限、工具边界和回写字段才是重点。

建议先准备五类信息。

-

任务目标:这次任务要完成什么,是生成内容、检查账号、整理线索,还是回写数据。

-

输入字段:至少要有任务 ID、账号组、素材来源、执行要求、截止时间、回写位置。

-

工具权限:明确能调用哪些工具,是否涉及浏览器、云手机、社媒账号、表格或内部系统。

-

状态字段:建议包含待执行、执行中、已完成、需人工复核、失败、已回写。

-

异常规则:登录失效、素材缺失、页面变化、目标为空、工具不可用时应该停止还是重试。

很多团队跳过这一步,结果 API 接通后才发现问题。任务能触发,但账号环境不清楚;工具能调用,但不知道是否用对;结果能返回,但没有地方保存。这样做不算真正的自动化,只是把混乱从人工界面搬到了接口里。Google 的 SEO Starter Guide 也强调结构清晰和信息可理解,任务记录同样需要清楚到下一位执行人能接着处理:Google SEO Starter Guide。

如果任务涉及多账号执行,建议先把账号分组和权限边界理清。可以参考 Jumei 的 多账号管理 思路,把账号、角色、环境和任务分层管理。这样 API 触发时不会把“谁来执行、用哪个账号、执行到哪一步”混在一起。

OpenClaw API 使用指南:任务触发、工具调用和结果回写 的核心步骤

一个完整的 OpenClaw API 使用流程,可以拆成三段:任务触发、工具调用、结果回写。每一段都要有输入、状态和失败处理,否则后续排查会很困难。

第一步:设计任务触发

任务触发不是简单发一个请求。它要告诉系统:做什么、为谁做、用什么条件做、做到什么程度算完成。

推荐的任务字段包括:

task_id:唯一任务编号,方便追踪和幂等处理。task_type:任务类型,比如内容生成、账号检查、线索整理。account_group:账号组或执行环境。input_payload:正文、素材、链接、规则或表格数据。callback_url:结果回写地址。priority:任务优先级。timeout:最长执行时间。review_required:是否需要人工复核。

第二步:限制工具调用边界

工具调用最容易失控。一个任务如果可以调用太多工具,排查时很难知道到底是哪一步出了问题。更稳妥的做法,是按任务类型配置可用工具。

例如,内容生成任务可以调用素材库、模板库、审核规则;账号检查任务可以调用浏览器、移动端环境、状态记录;线索整理任务可以调用表格、CRM 或私域承接系统。Jumei 的 自动化运营 更适合这类有工具边界的流程,而不是让所有任务都随意执行。

第三步:设计结果回写

结果回写不能只写“成功”或“失败”。至少要写回任务状态、输出内容、关键证据、失败原因和下一步动作。Android Developers 对应用开发流程的文档也会把运行、调试和记录分开说明,这类工程化习惯同样适合 API 任务设计:Android Developers。

一个可用的回写结构可以包含:

- 任务状态:完成、失败、需复核、部分完成。

- 输出结果:生成内容、检查结论、线索列表或数据摘要。

- 执行记录:开始时间、结束时间、调用工具、账号环境。

- 异常说明:失败步骤、错误类型、是否可重试。

- 复核建议:是否需要人工确认,确认人是谁。

结果回写做好后,API 才真正进入业务闭环。否则任务执行完了,团队还是要回头查聊天记录、截图和人工备注。

常见错误和排查方法

OpenClaw API 使用最常见的问题,不是接口完全不可用,而是“看起来执行了,但结果不可控”。这种问题更隐蔽,因为系统会留下成功记录,业务团队却无法直接使用结果。

常见错误可以分成五类:

- 任务目标太宽:一个任务同时要求生成内容、登录账号、发布、互动、回写数据,导致失败点太多。

- 输入字段不完整:缺少账号组、素材来源、目标链接、语言要求或执行边界。

- 工具权限过大:任务可以调用过多工具,结果难以复盘,也容易误用环境。

- 回写字段太少:只写回结果,不写执行证据和异常原因。

- 没有停止规则:遇到登录失效、页面变化、素材缺失时仍继续执行。

排查时不要先改代码。先看任务记录是否能回答四个问题:任务从哪里触发,使用了什么输入,调用了哪些工具,结果写回到哪里。如果这四个问题答不上来,优先补记录字段。

再看失败是否集中在某一类。比如多数失败来自账号登录,就要检查账号环境和权限;多数失败来自素材缺失,就要检查输入校验;多数失败来自回写失败,就要检查目标系统字段和接口状态。

如果任务涉及移动端执行,还要特别注意环境隔离。跨账号、跨设备、跨地区的任务,不要只靠一个通用执行环境。可以结合 Jumei 的 云手机 或真实设备环境思路,把移动端执行环境和账号任务分开管理。

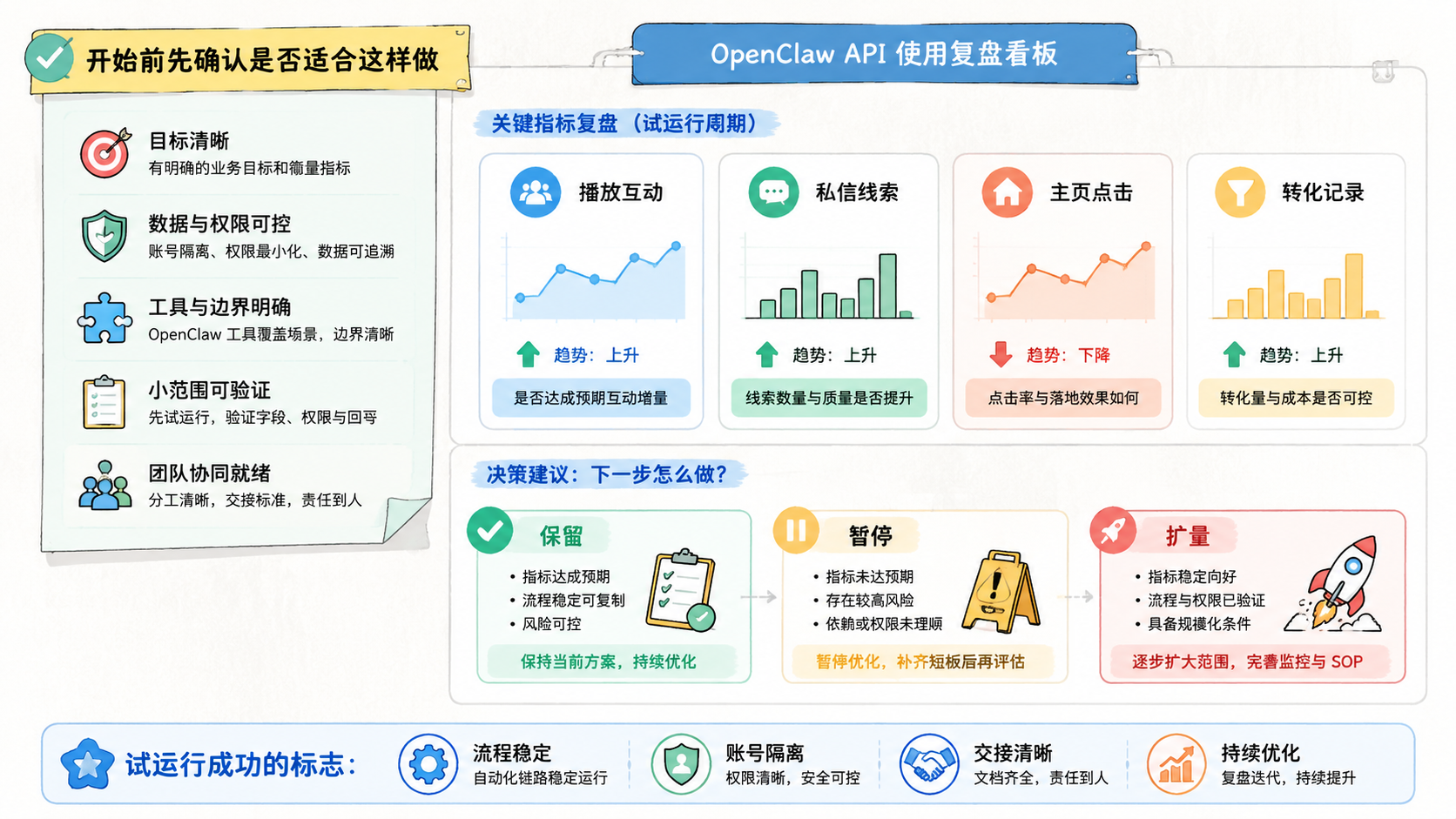

做完后怎么判断是否成功

判断 OpenClaw API 使用是否成功,不能只看接口返回 200,也不能只看任务状态显示完成。真正的判断标准,是业务人员是否能直接拿结果继续下一步。

可以用这个验收清单:

| 验收项 | 通过标准 | 不通过信号 |

|---|---|---|

| 任务触发 | 每个任务都有唯一 ID 和明确输入 | 同一任务重复执行却无法识别 |

| 工具调用 | 工具调用记录清楚,可追溯 | 不知道用了哪个账号或环境 |

| 输出内容 | 结果符合任务目标,可以复核 | 结果只有泛泛文本或缺少证据 |

| 回写记录 | 状态、结果、异常和时间都已保存 | 只看到成功/失败两个状态 |

| 失败处理 | 能区分可重试和需人工处理 | 失败后只能重新跑一遍 |

| 业务使用 | 运营、销售或负责人能继续处理 | 还要回头问执行人发生了什么 |

如果这些项都通过,说明 API 接入已经具备基本可用性。下一步再考虑扩大任务类型、增加并发、接入更多工具。顺序不要反过来。

对海外社媒矩阵团队来说,还要看结果是否进入复盘链路。比如内容发布后是否能看到互动数据,线索是否进入私域,账号状态是否能追踪。Jumei 的 数据监控分析 适合承接这种“执行后看结果”的环节。

试运行、验证与复盘

建议先用小范围任务试运行,而不是一开始就接入正式全量流程。试运行不是走形式,它是用来发现字段、工具、权限和回写规则是否完整。

一个合理的试运行可以这样设计:

- 选 1 个任务类型,比如内容生成或账号检查。

- 选 5 到 10 条真实但低风险的数据。

- 固定输入字段,不允许临时口头补充。

- 记录每次工具调用和状态变化。

- 要求结果回写到固定位置。

- 试运行结束后按失败原因分类。

复盘时重点看三件事。第一,任务失败是否有明确原因。第二,人工复核是否能看懂执行过程。第三,是否存在字段缺失导致的反复沟通。

如果试运行结果显示多数问题来自输入不完整,不要急着优化模型或工具。先把任务表单和字段校验补好。如果问题来自工具调用不稳定,再收窄工具边界。如果问题来自结果不可用,再调整回写结构和验收标准。

对于希望把 OpenClaw 接入获客、内容、账号运营的团队,建议把试运行结果和实际业务目标连起来。比如是否减少了人工复制粘贴,是否缩短了复核时间,是否让线索更快进入承接链路。Jumei 的 获客引流 场景更关注这种从执行到转化的连接。

常见问题

OpenClaw 是什么?

OpenClaw 可以理解为面向任务执行的 AI 能力入口。它更适合把任务、工具和结果连接起来,而不是只做一次问答。具体是否适合,要看团队是否已经有稳定流程和明确验收标准。

OpenClaw API 使用适合新手吗?

如果完全没有流程基础,新手不建议直接从 API 开始。更稳妥的方式是先把任务步骤写清楚,再用少量任务试运行。等字段、权限和回写方式稳定后,再接入 API。

OpenClaw 安装是不是必须先完成?

是否需要安装,取决于团队使用方式和部署形态。一般来说,使用 API 前至少要确认账号权限、调用方式、工具配置和回写地址。不要只看到接口文档就直接接正式业务。

OpenClaw 使用教程最容易漏掉什么?

最容易漏掉结果回写。很多教程会讲如何触发任务,却没有讲任务完成后怎么保存证据、状态和异常原因。没有回写,就很难复盘,也很难让业务团队继续处理。

任务触发失败应该先查哪里?

先查任务 ID、输入字段和权限。然后再看接口地址、鉴权、超时和任务类型。如果记录里没有这些字段,排查会很慢。

工具调用失败是不是模型问题?

不一定。工具调用失败可能来自权限不足、环境失效、输入缺失、页面变化或停止规则不清楚。不要一开始就归因给模型,先看执行日志和工具边界。

结果回写到哪里比较合适?

回写位置要和业务流程一致。可以是运营看板、CRM、表格、内容库或任务系统。关键不是位置高级,而是负责人能看到、能复核、能继续处理。

什么时候可以扩大任务量?

当小范围试运行能稳定触发、正确调用工具、完整回写结果,并且失败原因可以分类时,再扩大任务量。否则并发越高,问题越难查。

总结

OpenClaw API 使用的重点,不是把接口调通,而是把任务执行变成可追踪的业务闭环。任务触发要清楚,工具调用要有边界,结果回写要能复核。只有这三段都稳定,API 接入才有实际价值。

如果团队正在做海外社媒矩阵、内容运营、账号管理或私域引流,建议先从一个小任务开始。把输入字段、工具权限、状态记录、异常处理和回写位置定义好,再跑一轮试运行。通过验收后,再逐步接入更多场景。

下一步可以很具体:选一个每天重复发生、人工处理成本高、结果容易判断的任务,写出字段清单和回写结构,再用少量真实数据验证。这样做比直接追求“大而全”的自动化更容易落地,也更容易发现真正的执行瓶颈。